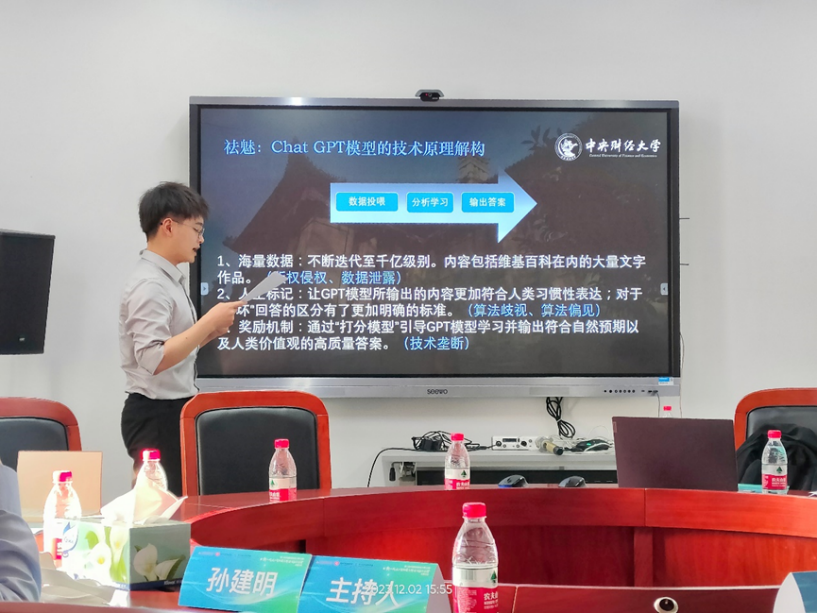

2023年12月2日,由全国高等院校计算机基础教育研究会网络科技与智能媒体设计专业委员会、中国新闻史学会智能与计算传播专业委员会、中国科技新闻学会科技传播理论研究专委会、教育部融合新闻课程群虚拟教研室等联合主办的“新一代人工智能信息传播与社会治理”论坛在深圳大学举办。会议收到了近300篇稿件,论坛现场来自中国人民大学、香港浸会大学、四川大学、清华大学、中央财经大学、南京大学、浙江大学、中国政法大学、武汉大学、贵州省毕节市威宁县人民检察院等单位的专家学者齐聚一堂,探讨人工智能对社会治理的深远影响,考量如何利用智能技术提升公共决策的质量和透明度。我校法学院2023级硕士研究生梅贻哲受邀参加“新一代人工智能社会治理法律专题”主题研讨,并就论文《祛魅Chat GPT:基于其技术原理的多元风险与法律规制框架》进行汇报。

图1 分论坛学术报告

当前,人工智能在信息传播领域正在进行新一轮的革新,告别了传统机器学习范式的程序化,突破了多模态大模型融合的限制。但与此同时,面对越发“人性化”的人工智能,如何进行合理的规范使用、如何保护用户的隐私安全等一系列社会问题逐渐浮现出来。生成式预训练变换模型(Chat GPT)的问世引发了社会广泛讨论,被认为是人类社会迈入“强人工智能时代”的开端。Chat GPT模型的技术框架主要依托于GAI与LLM,此外,巨量数据、人工标记与奖励机制也是GPT模型能够获得成功的关键技术模式。法律风险方面,主要存在版权风险与数据安全风险:GPT模型训练阶段的文本抓取行为存在结构性版权侵权风险,生成阶段又因其作为算法系统的特殊性而存在“回答”是否符合版权法视域下作品的构成要件、是否具备“可版权性”及其权利归属等问题;GPT模型在数据训练时主要采用“无监督”、人工标记特殊数据的训练模式以及其与用户交互式的应用模式可能会导致数据泄露、算法歧视与算法黑箱等结构性弊端,产生“技术霸权”与“数据污染”等现实风险。故而应当从不同维度分析GPT模型的多元风险,并且从“算法规制算法”的视角采用DRM、TETs等技术工具应对其潜在法律风险。此外,也应当结合我国新出台的《生成式人工智能服务管理办法》从顶层设计、行业监管、企业自律、技术标准、个人意识等方面分析法律规制进路。

返校后,梅贻哲同学于12月4日在学院南路校区中财大厦案例教室2举行了学术报告会,与大家分享了参会心得与研究成果。大家围绕文章的优缺点进行了探讨,并针对进一步改进的空间提出了建议。此次学术会议交流得到中央财经大学研究生学术交流支持计划的资助。